COMUNICADO DE PRENSA

16 mayo 2023

Apple presenta nuevas funcionalidades para la accesibilidad cognitiva, además de Live Speech, Personal Voice y Point and Speak en la Lupa

Nuevas funcionalidades de software para personas con dificultades cognitivas, visuales y del habla estarán disponibles próximamente este año

CUPERTINO, CALIFORNIA Hoy, Apple mostró un avance de funcionalidades de software para personas con dificultades cognitivas, visuales, auditivas y motrices, además de herramientas innovadoras para personas que no hablan o corren el riesgo de perder la capacidad de hablar. Estas actualizaciones aprovechan los avances en hardware y software, usan el aprendizaje automático del dispositivo para garantizar la privacidad del usuario y refuerzan el compromiso de larga data de Apple de fabricar productos para todos.

Apple trabaja en estrecha colaboración con grupos comunitarios que representan un amplio espectro de usuarios con discapacidades para desarrollar funcionalidades de accesibilidad que tengan un impacto real en la vida de las personas. Próximamente este año, los usuarios con discapacidades cognitivas podrán usar el iPhone y el iPad con mayor facilidad e independencia gracias a Assistive Access; las personas que no hablan podrán teclear para hablar durante llamadas y conversaciones con Live Speech, y quienes corren el riesgo de perder la capacidad de hablar podrán usar Personal Voice para crear una voz sintetizada que suene como ellos para conectarse con sus seres queridos. Para los usuarios con ceguera o visión reducida, el modo de detección en la Lupa ofrece la funcionalidad Point and Speak, que identifica el texto que señalan los usuarios y lo lee en voz alta para ayudarlos a interactuar con objetos físicos, como electrodomésticos.

"En Apple, siempre hemos creído que la mejor tecnología es la tecnología diseñada para todos", expresó Tim Cook, CEO de Apple. "Hoy, nos complace compartir estas nuevas e increíbles funcionalidades que se suman a nuestra larga historia de hacer la tecnología accesible, para que todos tengan la oportunidad de crear, comunicarse y hacer lo que más les gusta".

"La accesibilidad es parte de todo lo que hacemos en Apple", afirmó Sarah Herrlinger, directora sénior de Global Accessibility Policy and Initiatives de Apple. "Estas funcionalidades revolucionarias se diseñaron teniendo en cuenta comentarios de miembros de comunidades con discapacidades, para asistir a una diversa gama de usuarios y ayudar a las personas a conectarse de nuevas maneras".

Assistive Access brinda apoyo a los usuarios con discapacidades cognitivas

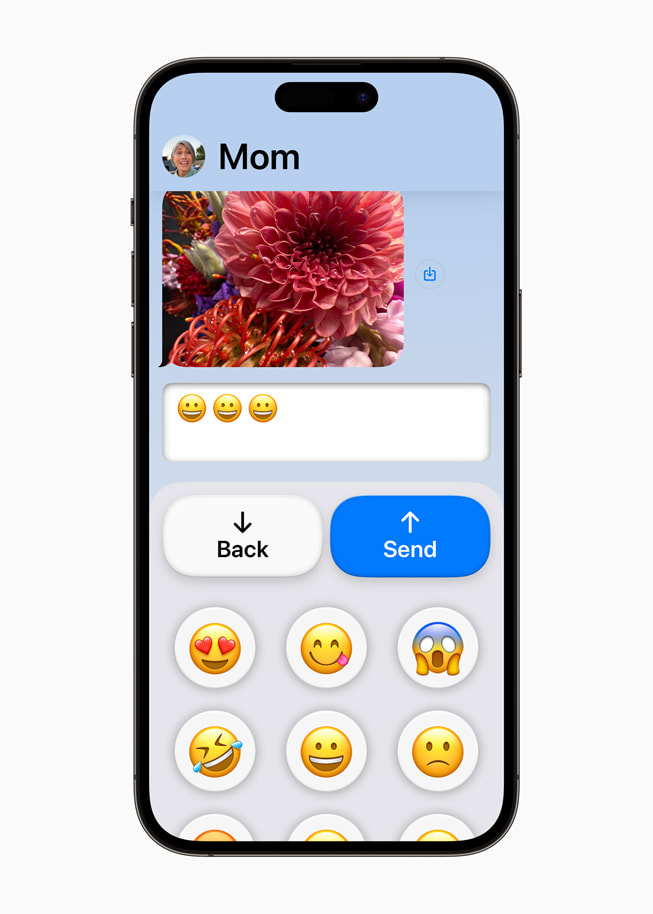

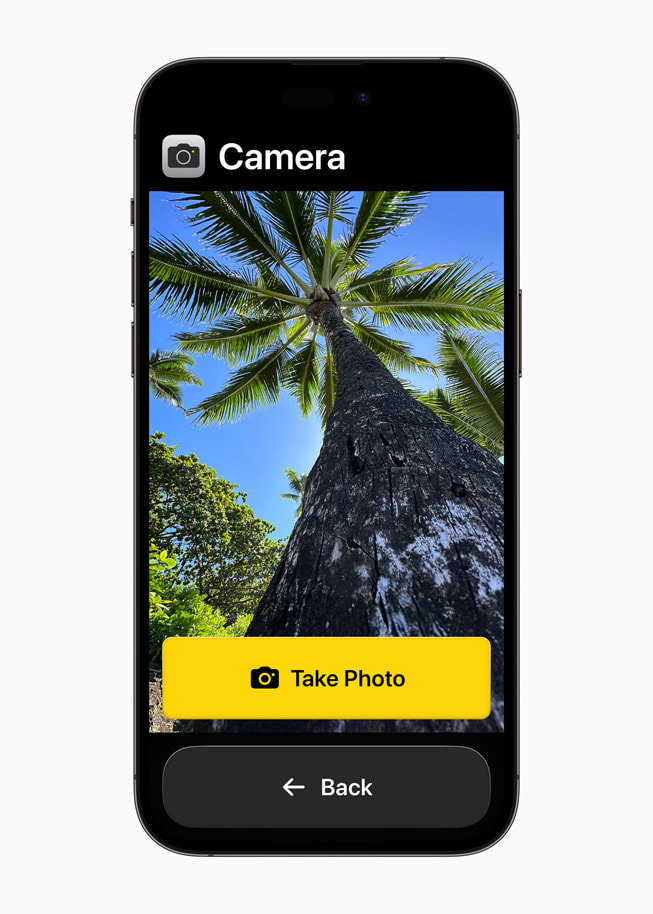

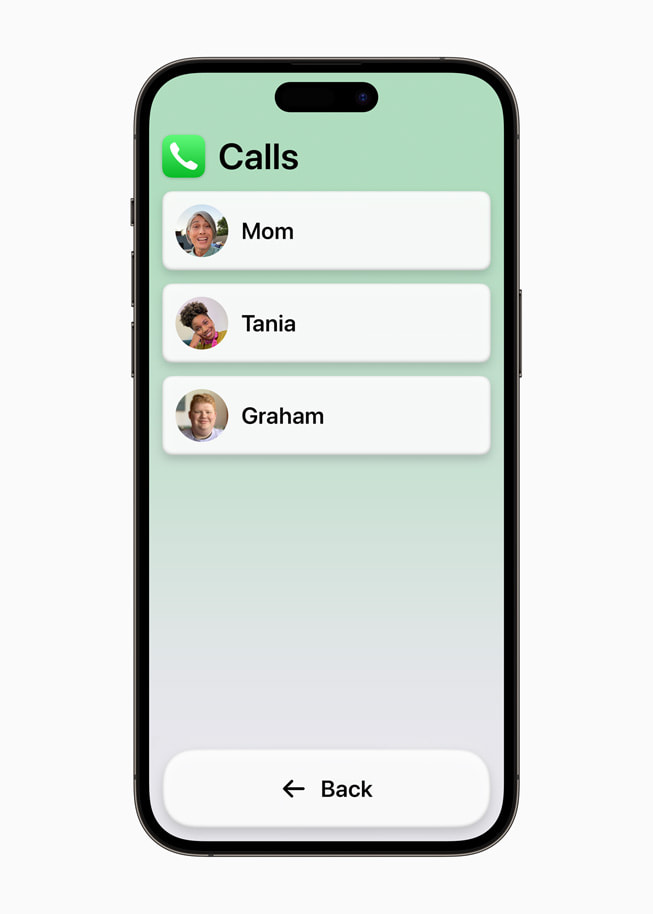

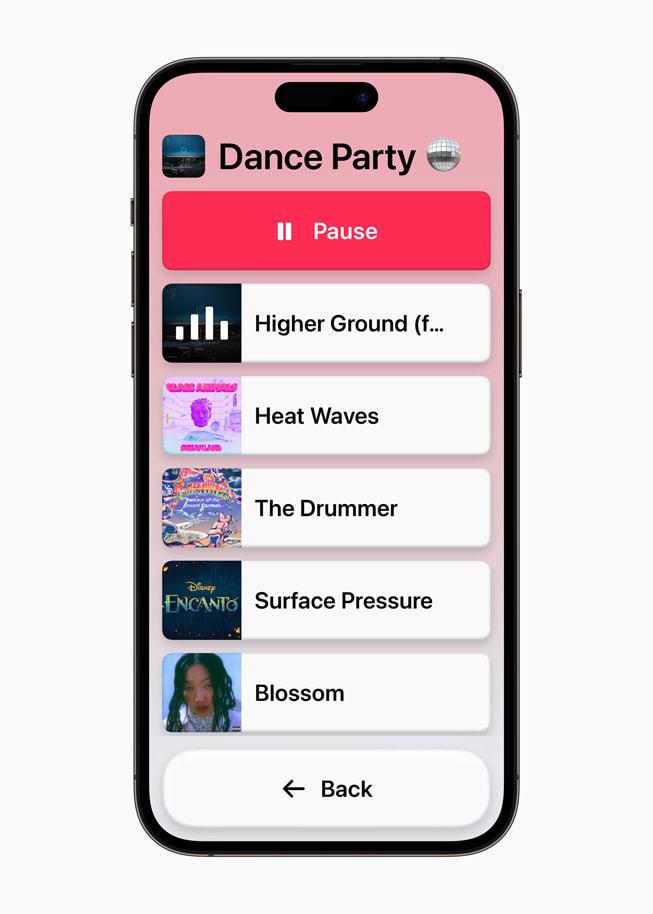

Assistive Access usa innovaciones en el diseño que simplifican apps y experiencias hasta sus funcionalidades esenciales para alivianar la carga cognitiva. Para desarrollar esta funcionalidad, se tuvieron en cuenta los comentarios de personas con discapacidades cognitivas y de sus acompañantes, haciendo foco en las actividades que disfrutan y que son esenciales en el iPhone y el iPad: conectarse con seres queridos, capturar y disfrutar fotos y escuchar música.

Assistive Access incluye una experiencia personalizada para llamadas de teléfono y FaceTime, que se combinan en una sola app Llamadas, además de Mensajes, Cámara, Fotos y Apple Music. La funcionalidad ofrece una interfaz diferenciada con botones de alto contraste y etiquetas de texto de gran tamaño, así como herramientas que ayudan a los acompañantes a adaptar la experiencia a las necesidades de la persona que asisten. Por ejemplo, para los usuarios que prefieren comunicarse de manera visual, Mensajes incluye un teclado de emojis y la opción de grabar un mensaje de video para compartir con los seres queridos. Además, los usuarios y sus acompañantes pueden elegir entre un diseño en cuadrícula más visual para la pantalla de inicio y las apps, o un diseño en filas en el caso de que prefieran el texto.

“La comunidad de personas con discapacidades intelectuales y del desarrollo está repleta de creatividad, pero la tecnología a menudo plantea barreras físicas, visuales o de conocimiento para estas personas”, declaró Katy Schmid, directora sénior de National Program Initiatives de The Arc of the United States. “Tener una funcionalidad que brinde una experiencia accesible desde el punto de vista cognitivo en el iPhone o el iPad significa más puertas abiertas a la educación, el empleo, la seguridad y la autonomía. Significa ampliar mundos y expandir potenciales".

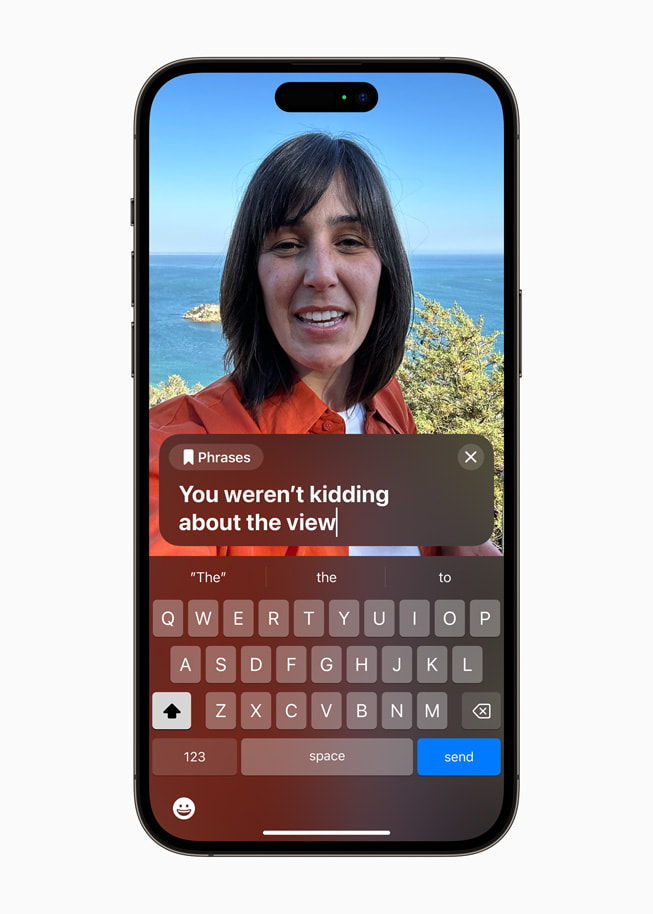

Live Speech y Personal Voice avanzan la accesibilidad para personas con discapacidad del habla

Con Live Speech en el iPhone, el iPad y la Mac, los usuarios pueden teclear lo que quieren decir y se leerá en voz alta durante llamadas telefónicas y de FaceTime, así como en conversaciones cara a cara. Los usuarios también pueden guardar frases que usan con frecuencia para activarlas durante una conversación animada con familiares, amigos y colegas. Live Speech se diseñó para asistir a millones de personas en el mundo que no pueden hablar o que han perdido el habla con el tiempo.

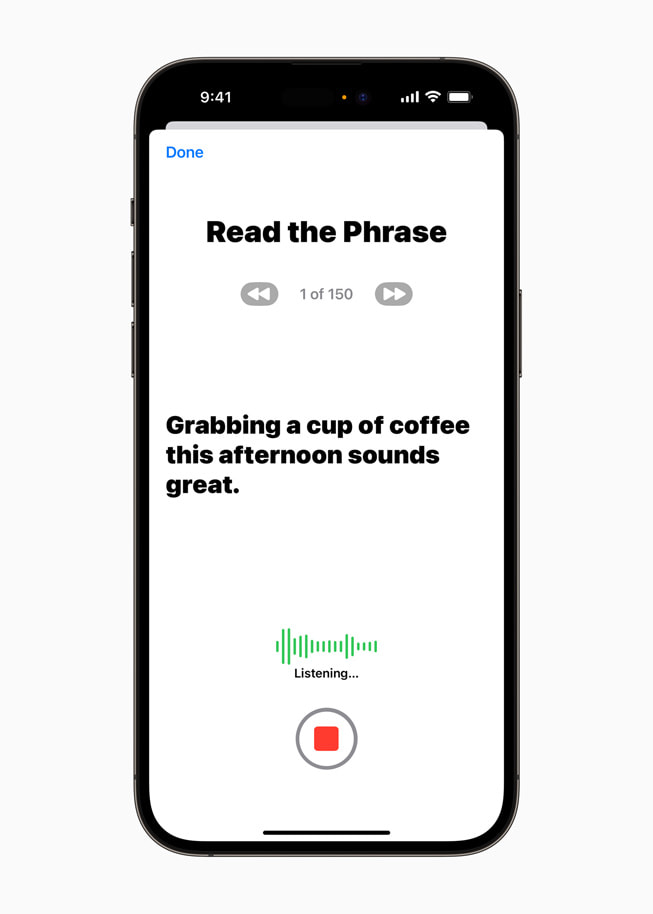

Para los usuarios que corren el riesgo de perder la capacidad de hablar, como aquellos con un diagnóstico reciente de ELA (esclerosis lateral amiotrófica) u otras afecciones que pueden afectar progresivamente el habla, Personal Voice es una forma simple y segura de crear una voz que suene como ellos.

Los usuarios pueden crear una voz personal al grabarse leyendo una serie aleatoria de textos durante 15 minutos con el iPhone o el iPad. Esta funcionalidad de accesibilidad usa el aprendizaje automático del dispositivo para mantener la información de los usuarios privada y segura, y se integra a la perfección con Live Speech para que las personas puedan hablar con su voz personal al comunicarse con sus seres queridos.1

"Al final del día, lo más importante es poder comunicarse con la familia y los amigos", expresó Philip Green, miembro de la junta de la organización sin fines de lucro Team Gleason, que concientiza sobre la ELA y ha experimentado cambios significativos en su voz desde que recibió el diagnóstico en el 2018. "Si puedes decirles que los quieres en una voz que suena como la tuya, eso hace toda la diferencia en el mundo. Y poder crear tu propia voz sintética en el iPhone en tan sólo 15 minutos es extraordinario".

El modo de detección de Lupa incorpora la funcionalidad Point and Speak para usuarios con ceguera o visión reducida

Point and Speak de Lupa facilita a los usuarios con discapacidades visuales interactuar con objetos físicos que tienen muchas etiquetas de texto. Por ejemplo, mientras usan un electrodoméstico, como un microondas, Point and Speak combina datos de la cámara, el escáner LiDAR y el aprendizaje automático del dispositivo para vocear el texto de cada botón a medida que los usuarios mueven el dedo sobre el teclado.2 Point and Speak se integra a la app Lupa del iPhone y el iPad, funciona a la perfección con VoiceOver y se puede usar con otras funcionalidades de la Lupa como Detección de Personas, Detección de Puertas y descripciones de imágenes para ayudar a los usuarios a desplazarse por su entorno físico.

Point and Speak de Lupa facilita a los usuarios con discapacidades visuales interactuar con objetos físicos que tienen muchas etiquetas de texto.

Otras funcionalidades

- Los usuarios sordos o con problemas de audición pueden enlazar dispositivos auditivos Made for iPhone a la Mac y personalizarlos para oír con mayor comodidad.3

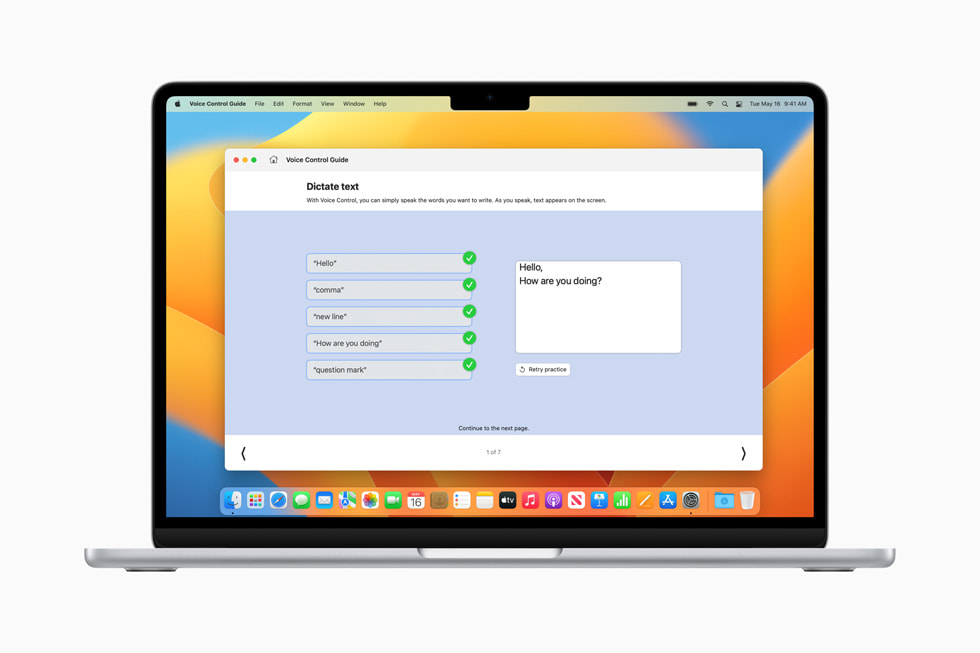

- Control por Voz agrega sugerencias fonéticas para editar textos. De esta manera, los usuarios que escriben con la voz pueden elegir la palabra correcta entre varias que pueden sonar parecidas, como "vaya", "valla" y "baya".4 Además, con la guía de Control por Voz, los usuarios pueden consultar consejos y trucos para usar los comandos de voz en lugar de las manos en el iPhone, el iPad y la Mac.

- Los usuarios con discapacidades físicas y motrices que usan Control por botón pueden convertir cualquier botón en un control de juegos virtual para disfrutar de sus juegos favoritos en el iPhone o el iPad.

- Para los usuarios con visión reducida, Tamaño del Texto ahora es más fácil de ajustar en las apps de la Mac como Finder, Mensajes, Mail, Calendario y Notas.

- Los usuarios con sensibilidad a las animaciones rápidas pueden pausar de forma automática imágenes con elementos en movimiento, como GIF, en Mensajes y Safari.

- Para los usuarios de VoiceOver, las voces de Siri suenan naturales y expresivas, incluso en reproducciones a alta velocidad. Es posible personalizar la velocidad a la que Siri habla, con opciones que van desde el 80% al 200% de la velocidad.

Celebramos el Día de Concientización sobre Accesibilidad Global en todo el mundo

En celebración del Día de Concientización sobre Accesibilidad Global, esta semana Apple presenta nuevas funcionalidades, colecciones especialmente seleccionadas y mucho más:

- SignTime se lanzará en Alemania, Italia, España y Corea del Sur el 18 de mayo para conectar a los clientes del Apple Store y el Soporte de Apple con intérpretes de lengua de señas a pedido. El servicio ya está disponible para clientes de Estados Unidos, Canadá, Reino Unido, Francia, Australia y Japón.5

- Algunas tiendas Apple Store de todo el mundo brindarán sesiones informativas durante toda la semana para ayudar a los clientes a descubrir las funcionalidades de accesibilidad, y la tienda Apple Carnegie Library ofrecerá una sesión de Today at Apple con la intérprete de lengua de señas Justina Miles. Y con reservaciones grupales disponibles durante todo el año, las tiendas Apple Store son un lugar ideal para que las comunidades aprendan juntas sobre las funcionalidades de accesibilidad.

- Atajos incorpora Remember This, que ayuda a los usuarios con discapacidades cognitivas a crear un diario visual en Notas para facilitar la consulta y la reflexión.

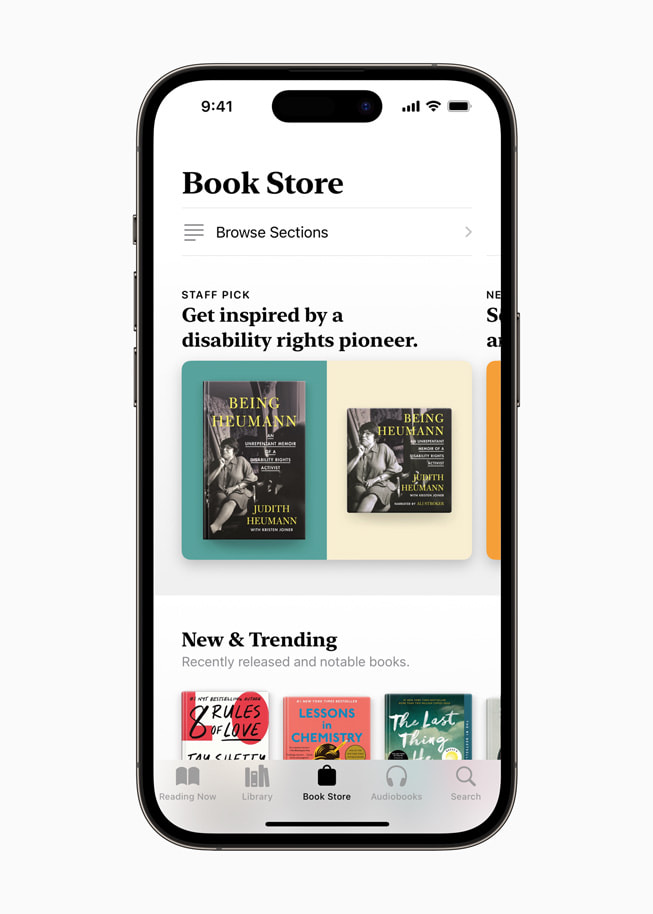

- Esta semana, Apple Podcasts brindará una colección de programas sobre el impacto de la tecnología accesible; la app Apple TV presentará películas y series seleccionadas por reconocidas mentes creativas de la comunidad de personas con discapacidad; Apple Books destacará Being Heumann: An Unrepentant Memoir of a Disability Rights Activist, la autobiografía de Judith Heumann, pionera en derechos sobre discapacidad, y Apple Music ofrecerá videos musicales de todos los géneros con lengua de señas estadounidense.

- Esta semana en Apple Fitness+, el entrenador Jamie-Ray Hartshorne incorpora la lengua de señas estadounidense al tiempo que destaca las funcionalidades disponibles que son parte de un esfuerzo continuo para hacer que la actividad física sea accesible para todos. Entre las funcionalidades se incluye Audio Hints, que brinda descripciones verbales breves para asistir a los usuarios con ceguera o visión reducida. Además, los episodios de Hora de Caminar y Hora de Correr se convierten en Hora de Caminar o Rodar y Hora de Correr o Rodar para los usuarios de silla de ruedas. Los entrenadores de Fitness+ incorporan el lenguaje de señas estadounidense a los entrenamientos y las meditaciones. Todos los videos incluyen subtítulos en seis idiomas, y los entrenadores ofrecerán variaciones de los ejercicios para que los usuarios de diferentes niveles puedan participar.

- El App Store destacará a tres líderes de la comunidad de personas con discapacidad (Aloysius Gan, Jordyn Zimmerman y Bradley Heaven), quienes compartirán sus experiencias como personas que no hablan y los efectos transformadores de las apps de comunicación aumentativa y alternativa en sus vidas.

Compartir el artículo

Media

-

Texto de este artículo

-

Imágenes de este artículo

- Voz Personal se puede crear con el iPhone, el iPad y la Mac con chip de Apple, y estará disponible en inglés.

- Point and Speak estará disponible en dispositivos iPhone y iPad con escáner LiDAR en inglés, francés, italiano, alemán, español, portugués, chino, cantonés, coreano, japonés y ucraniano.

- Los usuarios podrán enlazar los dispositivos auditivos Made for iPhone con algunos dispositivos Mac con el chip M1 y todos los dispositivos Mac con el chip M2.

- Las sugerencias fonéticas de Control por Voz estarán disponibles en inglés, español, francés y alemán.

- Las sesiones de SignTime están disponibles en Estados Unidos y Canadá con lengua de señas estadounidense (ASL), en Reino Unido con lengua de señas británica (BSL), en Francia con lengua de señas francesa (LSF),en Japón con lengua de señas japonesa (JSL) y en Australia con lengua de señas australiana (Auslan). El 18 de mayo, SignTime estará disponible en Alemania con lengua de señas alemana (DGS), en Italia con lengua de señas italiana (LIS), en España con lengua de señas española (LSE) y en Corea del Sur con lengua de señas coreana (KSL).